Menjawab Tantangan Deploy Canary dengan Observabilitas

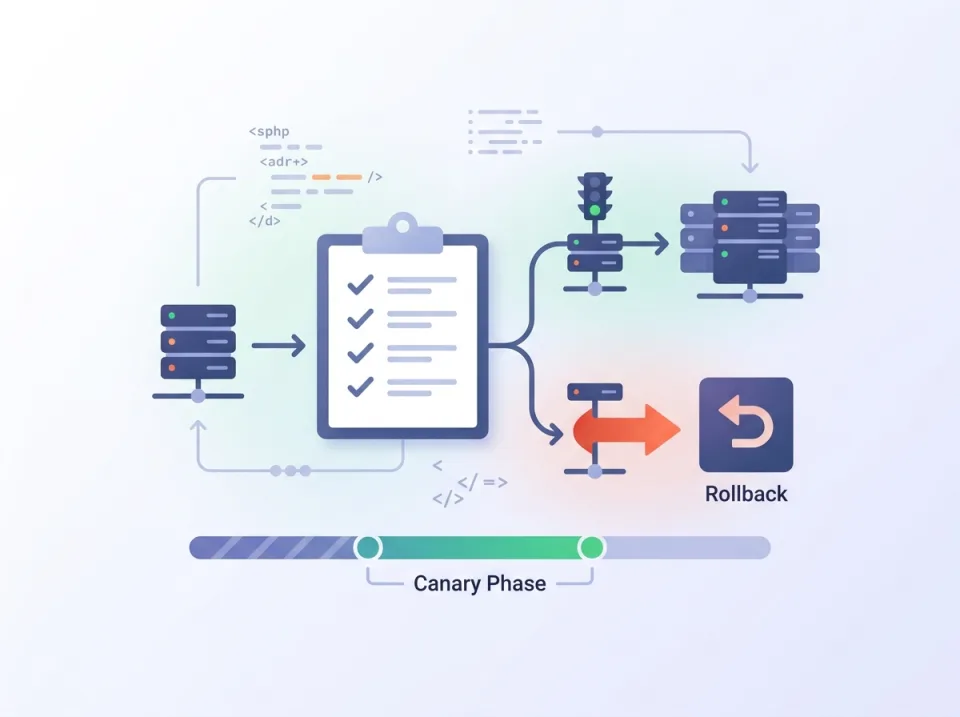

Deploy canary memungkinkan pengujian perilaku release baru terhadap sebagian trafik produksi. Untuk menjaga kestabilan layanan, observabilitas harus siap menangkap sinyal awal gangguan agar rollback bisa dieksekusi cepat. Artikel ini menguraikan checklist observabilitas yang menyiapkan tim teknik untuk melihat metrik utama, mengenali indikator penurunan kualitas, dan memutuskan rollback ringan tanpa menunggu eskalasi besar.

Fokusnya adalah layanan yang sudah berjalan dengan telemetry dasar (logs, metrics, tracing) aktif. Kita menyiapkan alat monitoring, kriteria keputusan, mekanisme komunikasi, dan dokumentasi post-release agar canary tetap aman.

1. Pra-Deploy: Checklist Observabilitas yang Menyiapkan Canary

- Ketersediaan dan Validitas Telemetry: Pastikan exporter/middleware yang menghasilkan metric latency, error rate, request per second, dan resource usage sudah aktif. Periksa bahwa data canary terlabel dengan jelas (mis.

deployment=canary), agar bisa difilter dan dibandingkan dengan baseline produksi. - Baseline dan SLO/SLI: Tetapkan SLO untuk latency p95, tingkat error 5xx, dan throughput prior untuk traffic canary. Simpan baseline historis 72 jam terakhir untuk memudahkan deteksi anomali.

- Alert Otomatis untuk Anomali Dini: Definisikan alert threshold berbasis perbandingan relatif terhadap baseline. Contoh sederhana (Prometheus) di bawah ini menandai kenaikan error rate ganda dalam 5 menit:

groups:

- name: canary.rules

rules:

- alert: CanaryErrorIncrease

expr: rate(http_requests_total{job="myservice",status=~"5.."}[5m]) >

(on(job) group_left() avg_over_time(rate(http_requests_total{job="myservice",status=~"5.."}[15m])[1h:15m]) * 2)

for: 5m

labels:

severity: critical

- Tracing dan Logs Terompilasi: Pastikan tracing distribusi (contoh: Jaeger, OTEL) menghubungkan request canary. Logging harus memuat

deployment=canarysehingga saat debugging bisa fokus pada segmen release baru. - Deck Informasi Status: Siapkan dashboard ringkas (Grafana/Loki/dll) yang menunjukkan perbandingan latency, error, dan error budget dengan baseline produksi.

- Uji Rollback Semu: Lakukan dry-run rollback untuk memastikan automation script atau runbook manual bekerja tanpa perlu hit real traffic.

2. Indikator Pemantauan Selama Canary

Selama canary berjalan, pantau lapisan telemetri berikut secara bersamaan agar keputusan rollback dibuat berdasarkan keseluruhan gambar performa.

Metrik Telemetri Utama

- Latency p95/p99: Kenaikan beruntun menunjukkan masalah di downstream atau resource limit.

- Error rate (5xx, 429): Bandingkan rate canary terhadap baseline. Alert yang melewati threshold (misalnya >2x) menandakan rollback diperlukan.

- Traffic Distribution: Pastikan canary mendapatkan trafik sesuai target (misalnya 5–10%). Jika kurang, evaluasi routing; jika lebih, batasi agar dampak besar dicegah.

- Resource Utilization: CPU/memory/queue backlog untuk canary pod. Spike bisa mengindikasikan konfigurasi baru menguras resource atau memicu throttling.

- Dependency Signals: Jika service menyentuh sistem lain (DB, cache), pastikan observability dependency juga tersedia sehingga latensi upstream tercermin.

Indikator Kualitatif

- Customer-Facing Errors: Alert dari synthetics atau real-user monitoring yang melaporkan permintaan gagal.

- Feedback Tim Support/CS: Komunikasi cepat dari first-line support dapat memberi konteks yang tak muncul di metrik.

3. Kapan Memicu Rollback Ringan

Rollback ringan berarti mengembalikan traffic canary ke versi stabil tanpa menghentikan seluruh release pipeline.

- Kriteria Rollback:

- Error rate canary >2x baseline selama >5 menit.

- Latency p95 meningkat >30% tanpa koreksi cepat.

- Alert kritikal dependency dengan korelasi langsung ke perubahan baru.

- Log exception novel yang tidak terdeteksi di review pre-release.

- Proses Keputusan: Saat kriteria terpenuhi, engineer on-call duduk bersama Product/QA (secara singkat) untuk memutuskan apakah rollback otomatis (alert memicu playbook) atau manual (patch/scale-down) diperlukan.

- Rollback Otomatis vs Manual: Otomatis cocok untuk parameter kuantitatif jelas (error rate), sedang manual lebih tepat untuk data kualitatif atau ketika tim butuh investigasi ringan.

4. Komunikasi Tim Saat Canary

Pemeriksaan observabilitas tidak cukup tanpa koordinasi. Komunikasi harus jelas, cepat, dan terdokumentasi.

- Alarm dan Notifikasi: Integrasikan alert ke saluran tim (Slack, Opsgenie) dengan link ke dashboard dan runbook rollback.

- Update Status Berkala: Selama canary, kirimkan status interval (misal setiap 10 menit) yang merangkum metric dan action yang diambil.

- Delegasi Keputusan: Tetapkan siapa yang bisa men-trigger rollback otomatis (biasanya engineer on-call) dan siapa yang harus diberitahu (owner release, SRE lead).

5. Runbook Rollback dan Dokumentasi Postmortem Ringan

Runbook harus spesifik, misalnya:

- Identifikasi versi canary (label image/tag).

- Gunakan automation tool (Argo Rollouts, Spinnaker, kubectl rollout undo) untuk mengurangi traffic.

- Validasi kembali setelah rollback bahwa metric kembali ke baseline.

- Catat timeline dan titik keputusan di incident log.

Setelah rollback, lakukan postmortem ringan dengan struktur:

- Ringkasan kejadian: Apa yang terjadi, karena metrik apa rollback diperlukan.

- Akar penyebab: Apakah bug kode, konfigurasi, atau dependency baru.

- Aksi pencegahan: Tambah unit test, perkuat observabilitas, atau ubah feature flag.

- Perbaikan observabilitas: Misalnya menambah metric baru atau alert untuk mencegah ambiguitas saat canary berikutnya.

6. Tindakan Pencegahan untuk Rilis Berikutnya

- Review Observability Coverage: Pastikan setiap rollback mengarah pada perbaikan data observasi (log, metric, trace).

- Automasi Validasi: Kembangkan smoke test atau synthetic check yang berjalan segera setelah canary dipromosikan.

- Eksperimen Bertahap: Pertimbangkan strategi pelan-pelan (misalnya gradual traffic increase) disertai evaluasi tiap tahap.

Dengan checklist ini, deploy canary tetap menjadi cara aman untuk menguji rilis baru, sekaligus memberi tim kontrol penuh saat rollback cepat diperlukan.

Komentar

0 komentar

Masuk ke akun kamu untuk ikut berkomentar.

Belum ada komentar

Jadilah yang pertama ikut berdiskusi!